İnsan beyninin yıllardır çözülemeyen elektriksel dili, yapay zekâ destekli beyin-bilgisayar arayüzleri sayesinde ilk kez anlamlı kelimelere, görüntülere ve hatta seslere dönüşmeye başlıyor.

Detaylar haberimizde…

Beynin içindeki elektriksel kıvılcımların çözülmesi uzun yıllar boyunca fazlasıyla karmaşık kabul edildi. Yapay zekâ bu tabloyu değiştirmeye başladı.

Nefes alış verişinin hafif yükselip alçalması dışında neredeyse hiç hareket etmeyen bir kadın, gözlerini ekrana sabitlemiş durumda. Önündeki ekranda kelimeler yavaş yavaş beliriyor, cümlelere dönüşüyor. Yüksek sesle ifade edemediği cümleler ekranda görünür hâle geliyor.

52 yaşındaki kadın, 19 yıl önce geçirdiği felç nedeniyle konuşma yetisini büyük ölçüde kaybetti. Ancak bu deney sırasında iç konuşması metne dönüşüyor.

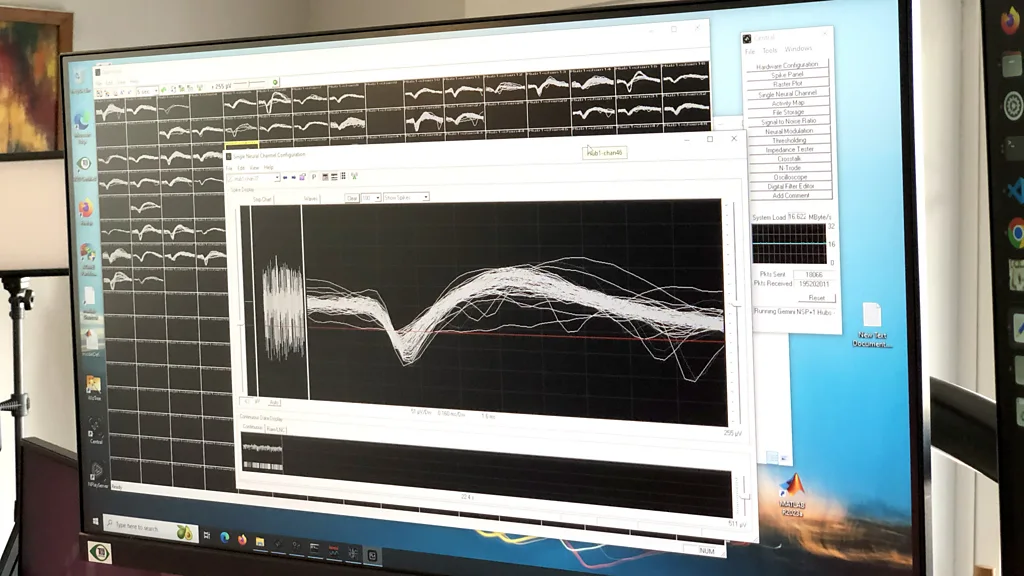

Yalnızca T16 olarak tanımlanan katılımcının beyninin ön lobuna cerrahi operasyonla küçük bir elektrot dizisi yerleştirildi. Yapay zekâ destekli bir bilgisayar sistemi, kelimeleri hayal ederken oluşan nöral sinyalleri çözümlüyor ve bunları ekrandaki yazıya dönüştürüyor. ABD’nin Kaliforniya eyaletindeki Stanford University bünyesinde yürütülen çalışmada, amyotrofik lateral skleroz (ALS) hastalığı bulunan üç kişiyle birlikte düşünceleri gerçek zamanlı metne dönüştürebilen bir teknik test ediliyor. Bu gelişme, şimdiye kadarki en ileri “zihin okuma” adımlarından biri olarak görülüyor.

Araştırmacılar başarıyı Ağustos 2025’te duyurdu. Birkaç ay sonra Japonya’daki bilim insanları, kişinin gördüklerini ya da zihninde canlandırdıklarını ayrıntılı biçimde betimleyebilen bir “zihin altyazılama” tekniğini açıkladı. Üç farklı yapay zekâ aracı ve invaziv olmayan beyin taramaları birlikte kullanılarak beyin aktivitesi anlamlı çıktılara çevrildi.

Bu çalışmalar, nörobilimcilere insan beyninin işleyişine dair yeni bir pencere açıyor ve iletişim kuramayan bireyler için yeni olanaklar sunuyor. Uzun vadede teknolojinin, insanların dünya ve birbirleriyle etkileşim biçimini kökten dönüştürme potansiyeli bulunuyor.

ABD’deki University of California, Davis Nöroprotez Laboratuvarı’nda beyin-bilgisayar arayüzleri üzerine çalışan nöromühendis Maitreyee Wairagkar, önümüzdeki yıllarda bu teknolojilerin ticarileşmesini bekliyor. Neuralink gibi şirketler, laboratuvar ortamındaki beyin çiplerini günlük yaşama taşımayı hedefliyor.

Beyin-Bilgisayar Arayüzlerinin Kısa Tarihi

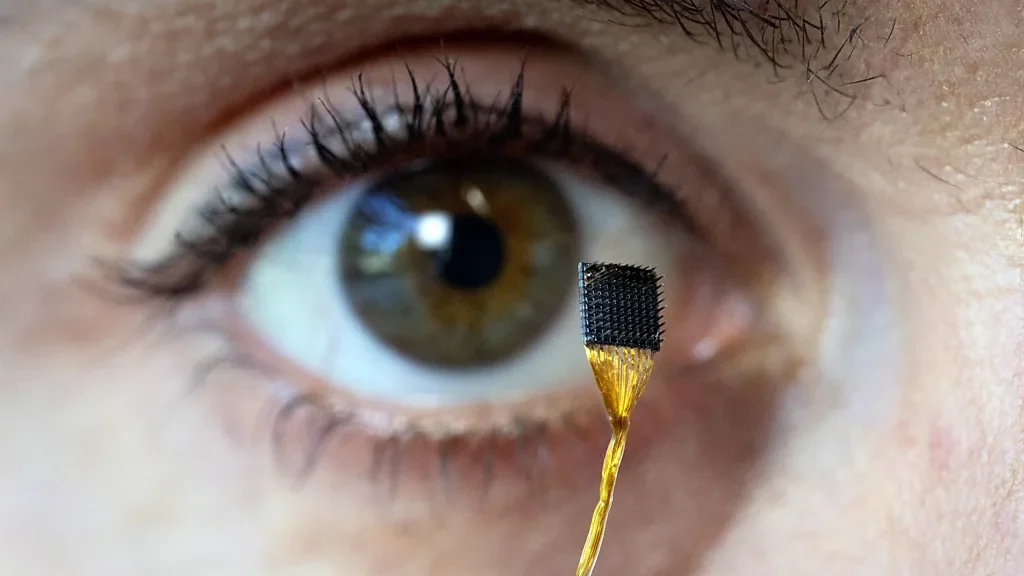

Beyne doğrudan yerleştirilen elektrotlar, kelime ve konuşmayla ilişkili düşüncelere karşılık gelen küçük elektriksel sinyalleri tespit edebiliyor. Beyin-bilgisayar arayüzleri üzerine çalışmalar sanılandan daha eskiye uzanıyor.

1969 yılında nörobilimci Eberhard Fetz, maymunların tek bir nöronun aktivitesiyle bir göstergenin ibresini hareket ettirmeyi öğrenebildiğini gösterdi. Aynı dönemde İspanyol bilim insanı Jose Delgado, öfkeli bir boğanın beynini uzaktan uyararak hayvanın hücumunu durdurdu.

On yıllardır bu sistemler, hareketle ilişkili beyin sinyallerini çözerek protez uzuv ya da bilgisayar imlecini kontrol etmeyi sağlıyor. Ancak konuşma ve karmaşık düşüncelerin çözümlenmesi daha yavaş ilerledi. Erken dönem çalışmaların çoğu insan dışı primatlar üzerinde yürütüldü; bu nedenle konuşma süreçleri doğrudan incelenemedi.

Konuşmanın Beyinden Metne Dönüşümü

Son yıllarda ALS ya da “kilitli kalma” sendromu gibi iletişim kısıtlılığı yaşayan bireylerde önemli ilerlemeler kaydedildi. 2021 yılında Stanford University araştırmacıları, dört uzvu felçli bir erkeğin havada harf çizdiğini hayal ederek dakikada 18 kelime yazabildiğini gösterdi.

Doğal konuşma hızı dakikada yaklaşık 150 kelime seviyesinde. 2024 yılında Wairagkar’ın laboratuvarı, ALS hastası bir bireyin konuşma girişimlerini doğrudan metne dönüştüren bir sistemi denedi. Dakikada yaklaşık 32 kelime ve yüzde 97,5 doğruluk oranı elde edildi.

Bu yöntemlerde beyin yüzeyine yerleştirilen mikroelektrot dizileri kullanılıyor. Elektrotlar belirli bir bölgedeki nöral aktivite örüntülerini kaydediyor; makine öğrenimi algoritmaları bu örüntüleri dilin en küçük birimleri olan fonemlerle eşleştiriyor. Süreç, dijital asistanların sesi tanımasına benzetiliyor; ancak burada çözümlenen şey ses değil, doğrudan nöral sinyal oluyor.

İç Konuşmayı Yakalamak

Uzun süre boyunca sistemlerin doğru çalışabilmesi için hastaların kelimeleri söylemeye çalışması istendi. Elektrotlar çoğunlukla hareketten sorumlu motor kortekse yerleştirildiği için konuşma girişimi önemli rol oynadı. Ancak konuşmaya çalışmak çaba gerektiriyor ve iletişimi yavaşlatıyor.

Stanford ekibi, iç konuşmanın gerçek zamanlı olarak yakalanıp yakalanamayacağını test etti. Katılımcılardan ekrandaki belirli renklerdeki şekilleri zihinden saymaları istendi. Bu görev sırasında motor kortekste sayı kelimelerine karşılık gelen izler tespit edildi.

Cümle hayal etme görevlerinde doğruluk oranı yüzde 74’e ulaştı. Daha serbest ve açık uçlu görevlerde ise anlamlı sonuçlar azaldı ve çözümlenen metin çoğu zaman anlamsız kaldı. Bulgular, iç konuşma ile konuşma girişimi arasında benzer nöral örüntüler bulunduğunu; ancak iç konuşma sinyallerinin daha zayıf olduğunu gösterdi.

Kelimelerin Ötesi: Tonlama ve Müzik

2025 yılında University of California, Davis ekibi yalnızca kelimeleri değil, tonlama, perde, hız ve ritim gibi sözsüz unsurları da çözebildiğini gösterdi. Böylece hastaların vurgu ve ifade biçimini aktarması mümkün hâle geldi.

Bir ALS hastası, sistem aracılığıyla cümle sonunda soru tonlaması yapabildi ve konuşurken perdeyi değiştirebildi. Basit melodileri mırıldanma görevlerinde ton farklılıkları tespit edildi. Test edenlerin yüzde 60’ı üretilen kelimeleri anlaşılır buldu.

Araştırmacılar, daha fazla nöronun örneklenmesiyle sistemlerin gelişeceğini öngörüyor. Mevcut çalışmalarda yüzlerce nöron izlenirken, insan beyninde milyarlarca nöron bulunuyor. Daha gelişmiş cihazlar daha zengin veri sağlayabilecek.

Görüntüleri ve Sesleri Yeniden Üretmek

Beyin taramalarını analiz ederek görülen görüntüleri yeniden üretmeye yönelik çalışmalar da hız kazandı. Fonksiyonel manyetik rezonans görüntüleme (fMRI) ile kaydedilen beyin aktiviteleri, yapay zekâ destekli görüntü üretim sistemlerine aktarılıyor.

Japonya’daki Nagoya Teknoloji Enstitüsü’nden Yu Takagi, 2023 yılında yayımladığı çalışmada Nagoya Institute of Technology bünyesinde Stable Diffusion algoritmasını kullandı. Sistem, deneklerin izlediği görüntülere benzer görseller oluşturabildi.

Araştırmalar, beynin arka kısmındaki oksipital lobun görsellerin düşük seviyeli özelliklerini; temporal lobun ise nesnelerin kavramsal kimliğini işlediğini ortaya koydu.

2025 yılında müzik dinlenirken alınan fMRI verilerinden ses yeniden üretme denemeleri yapıldı. Görsel yeniden üretime kıyasla kalite daha düşük kaldı; ancak müziğin temel karakteri ve kategorisi yakalandı. Bulgular, müzik algısının beyinde görsel algıdan farklı biçimde işlendiğini gösterdi.

Geleceğe Doğru

Bu alandaki ilerlemeler, halüsinasyonların yeniden oluşturulmasından rüyaların çözümlenmesine kadar geniş bir potansiyel taşıyor. Doğrudan beyinler arası iletişim ihtimali de tartışılıyor; ancak etik ve insan hakları boyutu henüz netlik kazanmış değil.

Teknik sınırlamalar devam ediyor. Görsel ya da işitsel deneyimlerin eğlence amaçlı doğrudan beyinde oluşturulması için en az 10 ila 20 yıllık bir geliştirme süreci öngörülüyor. Buna rağmen yapay zekâ destekli beyin çözümleri, insan zihninin sınırlarını genişletme yolunda önemli bir eşik olarak görülüyor.

Derleyen: Damla Şayan